KI-Infrastruktur auf Open-Source-Basis: Mirantis kündigt Support für NVIDIA NCX Infra Controller an

Cloud-Betriebsmodelle in die KI-Ära bringen

Mirantis engagiert sich seit mehr als einem Jahrzehnt im Bereich Open-Source-Private-Cloud und hat den Einsatz von OpenStack und Kubernetes bei einigen der weltweit größten Unternehmen und Dienstleistern begleitet. Cloud-Infrastruktur wandelt sich von auf Virtualisierung fokussierten Architekturen hin zu KI-nativen Plattformen. Mirantis nutzt hier seine Open-Source-Expertise und arbeitet eng mit Partnern zusammen, um diese Transformation durch Beiträge zu Technologien wie k0rdent, Kubernetes und OpenStack zu unterstützen. Dadurch bringt Mirantis bewährte Cloud-Betriebsmodelle in die KI-Ära: Modulare, mandantenfähige Infrastrukturmodelle auf Basis offener Standards anstatt proprietärer Silo-Lösungen.

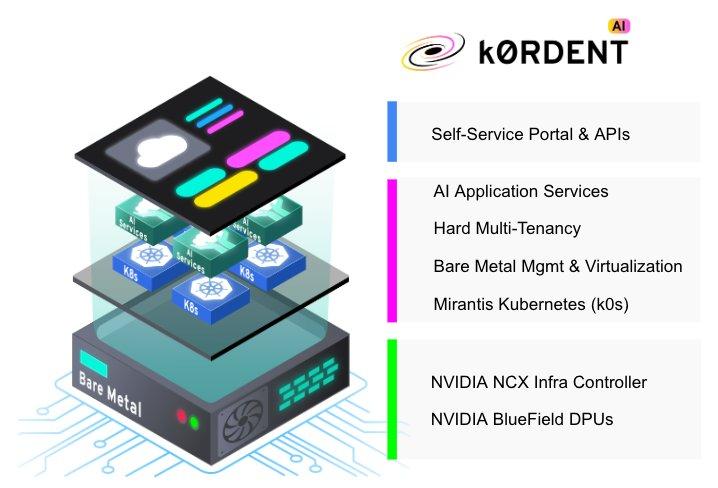

k0rdent AI: Metal-to-Model-Stack

Mit k0rdent AI erschafft Mirantis auf Basis der offenen KI-Infrastruktur-Module von NVIDIA einsatzbereite, mandantenfähige Cloud-Plattformen und bietet einen validierten „Metal-to-Model“-Stack für KI-Fabriken. k0rdent AI stellt eine einheitliche Steuerungsebene bereit, die den gesamten Stack über das NVIDIA-Referenzarchitektur-Portfolio hinweg orchestriert – von Architekturen wie NVIDIA Ampere, Hopper und Blackwell über Netzwerklösungen wie NVIDIA Quantum InfiniBand und Spectrum-X Ethernet bis hin zu den Systemplattformen NVIDIA DGX, HGX und MGX.

„Anbieter von KI-Infrastrukturdiensten stehen vor der Herausforderung, Auslastung und Effizienz zu maximieren“, erklärt Warren Barkley, Vice President Product Management bei NVIDIA. „Unsere Zusammenarbeit mit Mirantis hilft Neocloud-Anbietern, validierte KI-Infrastruktur schneller bereitzustellen. Die Kombination aus ISV-Validierung und der Lifecycle-Automatisierung des NVIDIA NCX Infra Controllers soll konsistente Performance, operative Effizienz und eine klare Differenzierung im Cloud-Markt ermöglichen.“

Integration des NVIDIA NCX Infra Controllers

Die Integration des NVIDIA NCX Infra Controllers ist Teil einer umfassenderen Strategie von Mirantis, Open-Source-Komponenten des NVIDIA-KI-Cloud-Stacks in k0rdent AI einzubinden und die Gesamtplattform im Rahmen der AI Cloud Ready Initiative von NVIDIA zu validieren. Mirantis beteiligt sich am NVIDIA NCX Infra Controller Open-Source-Projekt und arbeitet mit einer Reihe weiterer Unternehmen an einer offenen, modularen Infrastruktur-Plattform für KI.

Die Plattform soll Nutzern ermöglichen:

– Deployments anhand wiederholbarer Muster zu skalieren, anstatt auf manuelle Einzelintegrationen angewiesen zu sein.

– Die Bereitstellungszeit für KI-Infrastruktur durch Kubernetes-native Automatisierung zu verkürzen.

„Ein auf offenen Standards basierendes KI-Ökosystem ist entscheidend, um Kunden umfassende, schlüsselfertige KI-Lösungen anbieten zu können“, erklärt Shaun O’Meara, CTO von Mirantis. In der Zusammenarbeit mit NVIDIA und weiteren Partnern haben wir erhebliche Fortschritte rund um k0rdent erzielt – eine Technologie, die den Betrieb von KI-Infrastruktur automatisiert und gleichzeitig die Auslastung verbessert. So wie wir Pionierarbeit bei der Entwicklung moderner privater Clouds geleistet haben, spielt Mirantis nun eine wichtige Rolle für eine offene KI-Cloud-Infrastruktur für die nächste Generation von Workloads. Gleichzeitig tragen wir zur kontinuierlichen Weiterentwicklung von Community-getriebenen Technologien wie OpenStack und Kubernetes für neue KI-Anwendungsszenarien bei.“

Partnerschaften mit Netris, Supermicro und VAST Data

Netris: Mirantis und Netris haben kürzlich eine Integration vorgestellt, die die Kubernetes-Cluster-Bereitstellung und das Rechenzentrums-Netzwerkmanagement für KI-Workloads automatisiert. Dies löst zwei große Probleme: zum einen das Fehlen einer standardisierten Vorgehensweise für die Cluster-Bereitstellung, zum anderen die manuellen, fragmentierten Prozesse bei der Netzwerk-Provisionierung, die den Infrastruktur-Rollout ausbremsen. Durch den modularen Infrastruktur-Ansatz von Mirantis können Anwender validierte Networking-Technologien auswählen, die ihre jeweiligen Anforderungen an Performance und Betrieb erfüllen. Networking wird durch die Integration Teil der Kubernetes Cluster-Bereitstellung, anstatt nachträglich hinzugefügt oder manuell konfiguriert werden zu müssen.

Supermicro: Eine weitere Integration automatisiert den Betrieb in souveränen KI- und hybriden GPU-Cloud-Umgebungen. Supermicro-Nodes werden automatisch erkannt und als Kubernetes-Infrastruktur bereitgestellt.

VAST Data: Mirantis und VAST Data arbeiten daran, leistungsfähige Datendienste in k0rdent AI zu integrieren. Ziel ist es, aufwändige Einzelintegrationen zu reduzieren und eine schnellere Skalierung der KI-Infrastruktur zu ermöglichen.Durch diese Partnerschaften will Mirantis gemeinsam mit seinen Partnern KI-Infrastrukturdesigns standardisieren – einschließlich der von NVIDIA definierten Referenzarchitekturen, die festlegen, wie Rechenleistung, Netzwerk und Storage bei großen GPU-Umgebungen ineinandergreifen.

Mirantis auf der KubeCon Amsterdam

Mirantis zeigt die Automatisierungsmöglichkeiten von k0rdent für KI-Cloud-Services live auf der KubeCon in Amsterdam (23.– 26. März 2026, Stand 492).

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis bietet den schnellsten Weg zu einer wirtschaftlich rentablen und skalierbaren GPU-Cloud-Infrastruktur für Neoclouds und KI-Fabriken auf Enterprise-Ebene. Das Unternehmen stellt Full-Stack-KI-Infrastrukturtechnologien bereit, die Komplexität reduzieren und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Mit k0rdent AI und strategischen Partnerschaften mit NVIDIA ermöglicht es Mirantis Unternehmen, die Wirtschaftlichkeit von GPU-Cloud-Umgebungen zu verbessern – durch Multi-Tenancy, intelligente Workload-Orchestrierung und automatisierten Betrieb zur Maximierung von Auslastung und Rentabilität. Mit über 20 Jahren Erfahrung in der Bereitstellung unternehmenskritischer Open-Source-Cloud-Lösungen bietet Mirantis durchgängige Automatisierung, Sicherheit und Governance sowie fundiertes Know-how in den Bereichen Kubernetes und GPU-Orchestrierung. Dies versetzt Unternehmen in die Lage, die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – On-Premises, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

KI-Coding-Assistenten an Kubernetes anbinden: Lens integriert MCP-Server

Lens Desktop unterstützt Entwickler und Plattform-Spezialisten bereits beim Erkennen, Anbinden und Verwalten von Kubernetes-Clustern in On-Premises-Umgebungen sowie auf Cloud-Plattformen mit Integrationen für AWS und Azure. Die Unterstützung von Google Cloud wird bald folgen. Der neue MCP-Server stellt Konnektivität und den Cluster-Kontext für externe KI-Entwicklungs-Tools zur Verfügung. Dies reduziert den Aufwand für individuelle Integrationen, manuelle Setups oder den Einsatz von kubeconfig in KI-Tools.

„KI-Coding-Assistenten sind Teil des täglichen Entwickler-Workflows geworden. Kubernetes-Zugriff ließ sich bislang allerdings nur schwer in diese Erfahrung einbinden“, erklärt Miska Kaipiainen, Head of Product für Lens bei Mirantis. „Mit dem integrierten MCP-Server in Lens Desktop können Tools wie beispielsweise Claude Code Lens als Brücke nutzen, um mit Clustern zu arbeiten und sich mit deutlich weniger Aufwand zu verbinden.“

Verbindungsschicht zwischen KI-Tools und Kubernetes-Clustern

KI-Coding-Assistenten werden zunehmend für die Code-Entwicklung, das Debugging und alltägliche Aufgaben im Entwicklungsprozess eingesetzt. Die Einbindung von Kubernetes in diese Arbeitsabläufe erforderte jedoch bislang oft zusätzliche Skripte, Plug-ins oder manuelle Konfigurationen. Lens vereinfacht diesen Prozess, indem es als Verbindungsschicht zwischen den KI-Tools und den Kubernetes-Clustern fungiert, auf die Nutzer bereits über Lens Desktop zugreifen.

Die neue MCP-Integration baut auf Lens Prism auf, dem in Lens Desktop eingebauten KI-Assistenten für die Kubernetes-Fehleranalyse. Sie erweitert die bestehenden KI-Integrationen, indem Cluster-Konnektivität und Kontext über ein standardisiertes Protokoll bereitgestellt werden, welches mit einem wachsenden Ökosystem von KI-Tools kompatibel ist.

Features und Vorteile im Überblick

– Integrierter MCP-Server: Lens Desktop stellt Kubernetes-Konnektivität über MCP für KI-Assistenten und agentenbasierte Tools bereit.

– Cluster-Erkennung: KI-Tools können Cluster, die bereits über Lens Desktop verwaltet werden, automatisch erkennen und sich damit verbinden.

– Kompatibilität mit gängigen KI-Tools: Unterstützung für Claude Code, ChatGPT, Cursor, GitHub Copilot und weitere MCP-kompatible Clients.

– Geringerer Setup-Aufwand: Der Bedarf an eigenen Plug-ins, Verbindungsskripten oder manueller Integrationsarbeit beim Einbinden von Kubernetes in KI-gestützte Workflows wird deutlich reduziert.

– Bestehender Lens-Kontext: Verwendet die bereits in Lens vorhandene Nutzerauthentifizierung für die Cluster-Konnektivität.

– Sicherheit: Zugangsdaten und Cluster-Zugriff verbleiben auf dem Desktop des Nutzers.

Der integrierte Lens MCP-Server ist ab sofort in der aktuellen Version von Lens Desktop unter lenshq.io verfügbar. Weitere Details finden sich auch in diesem Blogbeitrag.

Über Lens

Lens von Mirantis ist eine Kubernetes-IDE mit mehr als einer Million Nutzern aus den Bereichen Entwicklung und Betrieb. Sie setzen Lens ein, um das Cluster-Management und DevOps-Workflows zu vereinfachen und die cloud-native Entwicklung zu beschleunigen. Weitere Informationen unter https://lenshq.io.

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis bietet den schnellsten Weg zu einer wirtschaftlich rentablen und skalierbaren GPU-Cloud-Infrastruktur für Neoclouds und KI-Fabriken auf Enterprise-Ebene. Das Unternehmen stellt Full-Stack-KI-Infrastrukturtechnologien bereit, die Komplexität reduzieren und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Mit k0rdent AI und strategischen Partnerschaften mit NVIDIA ermöglicht es Mirantis Unternehmen, die Wirtschaftlichkeit von GPU-Cloud-Umgebungen zu verbessern – durch Multi-Tenancy, intelligente Workload-Orchestrierung und automatisierten Betrieb zur Maximierung von Auslastung und Rentabilität. Mit über 20 Jahren Erfahrung in der Bereitstellung unternehmenskritischer Open-Source-Cloud-Lösungen bietet Mirantis durchgängige Automatisierung, Sicherheit und Governance sowie fundiertes Know-how in den Bereichen Kubernetes und GPU-Orchestrierung. Dies versetzt Unternehmen in die Lage, die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – On-Premises, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale. Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

Validierter „Metal-to-Model“-Stack für NVIDIA Cloud Partner: Mirantis wird Gründungspartner der NVIDIA AI Cloud Ready Initiative

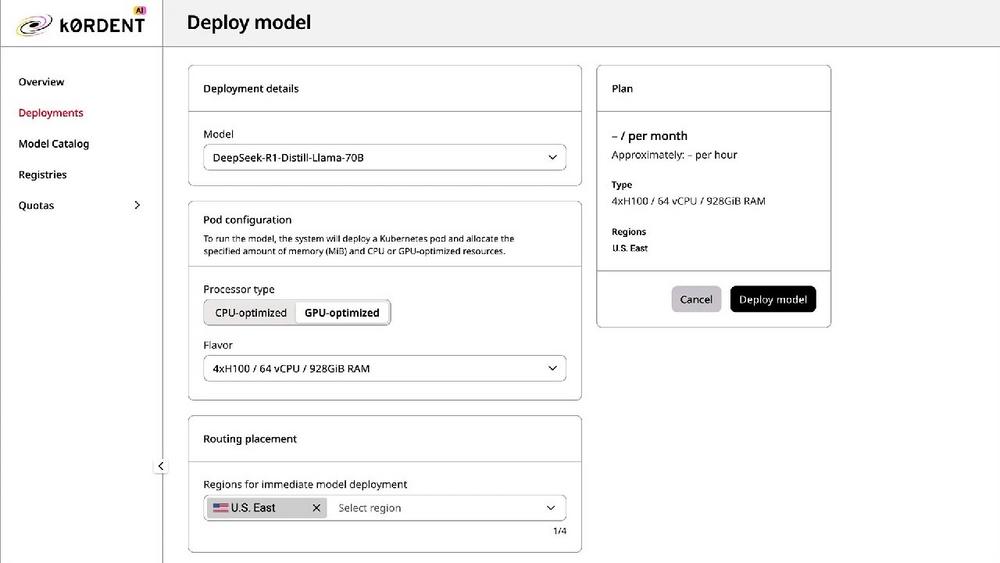

Für Neoclouds und die Betreiber von KI-Infrastrukturen ist Mirantis k0rdent AI eine schlüsselfertige Lösung für automatisierte, mandantenfähige KI-Clouds mit optimierter Auslastung. Abgedeckt werden Bare Metal und Kubernetes ebenso wie virtuelle Maschinen und Managed KI-Services.

„Mit k0rdent AI können NVIDIA Cloud Partner von manuellen Abläufen auf mandantenfähige Self-Service-Plattformen umsteigen, die das wirtschaftliche Potenzial der GPU-Infrastruktur ausschöpfen“, sagt Shaun O’Meara, Chief Technology Officer bei Mirantis. „Betreiber profitieren ab dem ersten Tag von NVIDIA-zertifizierten Modellen. Mit k0rdent AI können sie einfach NVIDIA-zertifizierte Hardware anschließen, den Rest übernimmt die Plattform.“

k0rdent AI nutzt den NVIDIA NCX Infra Controller, eine quelloffene Technologie, die bei NVIDIA zur Verwaltung großer GPU-Flotten entwickelt wurde. k0rdent AI stellt eine einheitliche Steuerungsebene bereit, die den gesamten Stack über das NVIDIA-Referenzarchitektur-Portfolio hinweg orchestriert – von Architekturen wie NVIDIA Ampere, Hopper und Blackwell über Netzwerklösungen wie NVIDIA Quantum InfiniBand und Spectrum-X Ethernet bis hin zu den Systemplattformen NVIDIA DGX, HGX und MGX.

NCP-Anbieter und KI-Fabriken stehen unter zunehmendem Druck, GPU-Infrastrukturen in tragfähige, nachhaltige Einnahmequellen umzuwandeln. Die Nachfrage nach KI-Diensten wächst weiterhin stark (laut Prognose der Analysten von Gartner werden die weltweiten KI-Ausgaben im Jahr 2026 einen Gesamtwert von 2,5 Billionen US-Dollar erreichen). Viele Deployments sind jedoch durch manuelle Bereitstellungsprozesse, Einzelmandanten-Architekturen und fragmentierte Lösungen eingeschränkt.

„Anbieter von KI-Infrastrukturdiensten stehen vor der Herausforderung, Auslastung und Effizienz maximieren“, erklärt Warren Barkley, Vice President Product Management bei NVIDIA. „Unsere Zusammenarbeit mit Mirantis hilft Neocloud-Anbietern, validierte KI-Infrastruktur schneller bereitzustellen. Die Kombination aus ISV-Validierung und der Lifecycle-Automatisierung des NVIDIA NCX Infra Controllers soll konsistente Performance, operative Effizienz und eine klare Differenzierung im Cloud-Markt ermöglichen.“

In der Gründungsgruppe der ISV-Partner ist Mirantis der einzige Anbieter, der eine offene, modulare Infrastrukturplattform beisteuert, die speziell für den vollständigen Neocloud-Lifecycle konzipiert ist: von Bare Metal bis zur Bereitstellung mandantenfähiger KI-Dienste.

Weitere Informationen finden sich auch im Mirantis Blog.

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis bietet den schnellsten Weg zu einer wirtschaftlich rentablen und skalierbaren GPU-Cloud-Infrastruktur für Neoclouds und KI-Fabriken auf Enterprise-Ebene. Das Unternehmen stellt Full-Stack-KI-Infrastrukturtechnologien bereit, die Komplexität reduzieren und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Mit k0rdent AI und strategischen Partnerschaften mit NVIDIA ermöglicht es Mirantis Unternehmen, die Wirtschaftlichkeit von GPU-Cloud-Umgebungen zu verbessern – durch Multi-Tenancy, intelligente Workload-Orchestrierung und automatisierten Betrieb zur Maximierung von Auslastung und Rentabilität. Mit über 20 Jahren Erfahrung in der Bereitstellung unternehmenskritischer Open-Source-Cloud-Lösungen bietet Mirantis durchgängige Automatisierung, Sicherheit und Governance sowie fundiertes Know-how in den Bereichen Kubernetes und GPU-Orchestrierung. Dies versetzt Unternehmen in die Lage, die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – On-Premises, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

Mirantis wird Partner in der VAST Data Cosmos Community

Mirantis wird in diesem Rahmen gemeinsam mit VAST Data einen standardisierten Integrationspfad für VAST-Technologien innerhalb des Mirantis k0rdent AI Ökosystems etablieren. Durch die Kombination der flexiblen und skalierbaren Multi-Cluster-Plattform von k0rdent mit dem KI-Betriebssystem von VAST sollen Neoclouds den Integrationsaufwand reduzieren sowie Hochleistungs-Inferenz und KI-Dienste schneller bereitstellen können – in einem Umfeld, in dem GPU-Auslastung und Datendurchsatz die Infrastrukturökonomie direkt beeinflussen.

„Neoclouds stehen unter dem konstanten Druck, aus jeder GPU-Stunde mehr herauszuholen“, erklärt Kevin Kamel, Vice President of Product Management bei Mirantis. „Durch die Zusammenarbeit mit VAST Data im Rahmen der Cosmos Community schaffen wir einen wiederholbaren, standardbasierten Weg, um hochleistungsfähige Datendienste in das k0rdent AI Ökosystem zu integrieren. Das hilft Betreibern dabei, schneller zu skalieren, den Betrieb zu vereinfachen und sich auf tatsächliche Ergebnisse zu konzentrieren, statt individuelle Integrationsarbeit leisten zu müssen.“

Die Performance moderner KI-Infrastruktur hängt zunehmend davon ab, Datenengpässe und technologische „Flaschenhälse“ zu beseitigen, die teure GPU-Kapazitäten ungenutzt lassen. Die Plattform von VAST Data vereint Datendienste zur Unterstützung von KI-Workflows über Training, Inferenz und agentische Systeme hinweg.

Mirantis und VAST Data richten ihre Zusammenarbeit an breiteren Ökosystem-Initiativen zur Standardisierung von KI-Infrastruktur aus. Dies beinhaltet beispielsweise NVIDIA-geführte Referenzarchitekturen, die definieren, wie Rechenleistung, Netzwerk und Storage für große und sehr große GPU-Umgebungen zusammengestellt werden.

„Führende Unternehmen im Bereich KI-Infrastruktur setzen zunehmend auf validierte Bausteine statt auf individuelle Stacks“, sagt John Mao, Vice President of Global Technology Alliances bei VAST Data. „Mit dem Beitritt zur VAST Cosmos Community bringt Mirantis seine Orchestrierungs-Expertise ein, die Betreibern hilft, das VAST KI-Betriebssystem in KI-Fabriken einzusetzen. Dies beschleunigt die Bereitstellung, reduziert den Integrationsaufwand und sorgt für mehr Performance.“

Die Kooperation richtet sich an Neoclouds, die GPU-Clouds und KI-Dienste aufbauen und dabei folgende Ziele verfolgen:

- Maximierung der GPU-Nutzung durch Reduzierung von Storage- und Datenpipeline-Engpässen

- Skalierung von Deployments mit wiederholbaren Mustern statt individueller Integrationen

- Schnellere Einführung von KI-Infrastrukturdiensten durch Kubernetes-native Automatisierung

Weitere Informationen: https://www.mirantis.com/…

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis bietet den schnellsten Weg zu einer wirtschaftlich rentablen und skalierbaren GPU-Cloud-Infrastruktur für Neoclouds und KI-Fabriken auf Enterprise-Ebene. Das Unternehmen stellt Full-Stack-KI-Infrastrukturtechnologien bereit, die Komplexität reduzieren und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Mit k0rdent AI und strategischen Partnerschaften mit NVIDIA ermöglicht es Mirantis Unternehmen, die Wirtschaftlichkeit von GPU-Cloud-Umgebungen zu verbessern – durch Multi-Tenancy, intelligente Workload-Orchestrierung und automatisierten Betrieb zur Maximierung von Auslastung und Rentabilität. Mit über 20 Jahren Erfahrung in der Bereitstellung unternehmenskritischer Open-Source-Cloud-Lösungen bietet Mirantis durchgängige Automatisierung, Sicherheit und Governance sowie fundiertes Know-how in den Bereichen Kubernetes und GPU-Orchestrierung. Dies versetzt Unternehmen in die Lage, die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – On-Premises, in der Public Cloud, hybrid oder auf Edge-Geräten. Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

Mirantis unterstützt Unternehmen mit MCP AdaptiveOps-Services bei Aufbau und Betrieb einer agentenbasierten KI-Infrastruktur

„Durch die jüngst erfolgte Übergabe von MCP an die Open-Source-Community im Rahmen der Agentic AI Foundation rechnen wir mit einer noch schnelleren Verbreitung und Weiterentwicklung der Technologie“, sagt Randy Bias, Vice President of Open Source Strategy &Technology bei Mirantis. „In dieser frühen Phase von KI und MCP nutzen wir unsere Expertise, um Unternehmen auf jeder Ebene zu unterstützen, vom Einstieg bis hin zu vollständigen Implementierungen. Unser anpassungsfähiger Ansatz hilft Unternehmen, sicher durch das Chaos zu navigieren. Die Grundlage bilden offene Standards und eine flexible Architektur, die mit der Technologie mitwachsen kann.“

Im Herbst 2025 hat Mirantis erstmals sein MCP AdaptiveOps-Framework vorgestellt, mit dem Entwicklerteams MCP-Server sicher und zuverlässig aufbauen und betreiben können, während gleichzeitig Interoperabilität und Compliance im Zuge der Weiterentwicklung des MCP-Ökosystems gewährleistet werden. MCP AdaptiveOps ist ein zukunftssicheres Framework, das die Unsicherheiten im schnelllebigen Ökosystem aus Registries, Gateways und LLM-Routern beseitigt. Die Bereitstellung von MCP-Servern wird beschleunigt. Gleichzeitig lassen sich diese flexibel an alle Standards und Komponenten anpassen, die während der weiteren Entwicklung des Model Context Protocol entstehen.

Auf diesem Framework baut Mirantis jetzt mit den MCP AdaptiveOps-Services auf, die Folgendes umfassen:

– Agentic Readiness Assessment – ein zweitägiges Strategie- und Discovery-Projekt, das zu einem Report und einer Priorisierung der ersten Anwendungsfälle führt.

– Agentic Engineering Bootcamp – ein dreitägiger Hands-on-Workshop, der wahlweise vor Ort oder remote für bis zu zehn Mitarbeitende durchgeführt wird.

– MCP Server Factory – ein drei- bis sechswöchiges Projekt zur Erstellung wiederverwendbarer MCP-Templates, Workflows und Best Practices.

– MCP Server Development – ein vier- bis achtwöchiges Entwicklungsprojekt zur Konzeption und Implementierung von MCP-Servern oder -Agenten.

– KI-Risiko & Compliance Operating Model – vier- bis achtwöchiges Consulting zur Abstimmung der Agentic-Plattform und der Prozesse des Kunden mit internen Richtlinien und externen Frameworks, einschließlich Auditing/Reporting für Agentic-Systeme.

– Agentic Platform Design & Implementation – ein acht- bis 16-wöchiges Projekt zum Entwurf und zur Implementierung einer Agenten-Plattform. Dies umfasst Multi-Tenancy, Governance-Richtlinien, Kontrollierbarkeit und die Integration mit Large Language Models (LLMs).

Weitere Informationen zu den Mirantis MCP AdaptiveOps-Services: https://www.mirantis.com/…

Mirantis bietet den schnellsten Weg zu skalierbarer KI für Unternehmen mit Full-Stack-KI-Infrastruktur-Technologien, die die Komplexität der GPU-Infrastruktur beseitigen und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Heute ist jede Infrastruktur auch KI-Infrastruktur. Mirantis stellt End-to-End-Automatisierung, Sicherheit und Governance auf Enterprise-Niveau sowie umfassende Expertise im Bereich Kubernetes-Orchestrierung zur Verfügung – Aspekte, die für Unternehmen essentiell sind, um die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – lokal, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

Mirantis k0rdent Enterprise ermöglicht Workloads auf virtualisierten und Cloud-nativen Infrastrukturen

„Innovative IT-Teams suchen derzeit nach Virtualisierungsalternativen. Da KI die IT-Anforderungen von Unternehmen verändert, ist genau jetzt ein entscheidender Zeitpunkt für die Modernisierung der Infrastruktur“, sagt Shaun O’Meara, Chief Technology Officer bei Mirantis. „Mirantis k0rdent Enterprise vereint nun VMs, Container und KI auf einer einzigen modernen Infrastrukturplattform. Durch die Beseitigung von operativen Silos durch einheitliches Management und Orchestrierung können Unternehmen die Komplexität des Betriebs und die Infrastrukturkosten reduzieren.“

Mirantis k0rdent Enterprise ermöglicht Virtualisierung im großen Maßstab überall – in öffentlichen Clouds, in On-Premises-Rechenzentren sowie in Edge- und Hybridumgebungen. Die Plattform bietet vollständige Kontrolle, Kostentransparenz und Übersicht rund um virtualisierte Workloads, die für verteilte und zentralisierte Anwendungen erforderlich sind.

Zu den wichtigsten Funktionen der neuen Version von Mirantis k0rdent Enterprise gehören:

– Automatisierter Distributed Resource Balancer (DRB) für virtuelle Maschinen, um Server mit ausreichend verfügbaren CPU- und RAM-Ressouren zu identifizieren und Node Balancing durchzuführen. Dies sorgt für optimale Performance ohne manuelle Eingriffe.

– Wichtige Updates für die KI-Umsetzung in Übereinstimmung mit der Mirantis KI-Referenzarchitektur, darunter:

– Erhalt der NUMA-Topologie mit Unterstützung der für GPU-Passthrough erforderlichen VM-Konfiguration, um eine optimale Leistung zu erzielen

– Hugepages und CPU-Pinning zur Leistungssteigerung durch effizientes Speichermanagement und dedizierte Prozessor-Ressourcen

– Unterstützung für die aktuellste KubeVirt-Version 1.6

– Unterstützung für den neuesten Ceph-Speicher 19.2.3 Squid

Mirantis k0rdent Enterprise basiert auf der Open-Source-Plattform k0rdent, einer Kubernetes-Managementplattform. Diese ermöglicht es Platform-Engineering-Spezialisten, eine konsistente, richtlinienbasierte Kubernetes-Infrastruktur zu definieren, bereitzustellen und zu betreiben. Dabei kommen unter anderem deklarative Automatisierung, GitOps-Workflows und validierte Templates aus dem Mirantis-Ökosystem zum Einsatz. k0rdent nutzt die Open Source k0s CNCF Sandbox Kubernetes Distribution, vereinfacht das Infrastrukturmanagement und beschleunigt Initiativen zur digitalen Transformation.

Die neuen Möglichkeiten von k0rdent, VMs auszuführen, erstrecken sich auch auf Mirantis Kubernetes Engine for k0rdent (MKE 4k). Die Lösung kann zusätzlich zu Containern nun auch virtuelle Maschinen ausführen.Die neue Version von Mirantis k0rdent Enterprise und MKE 4k bieten Alternativen zu proprietären Virtualisierungslösungen. Durch die Unterstützung älterer Infrastrukturen eignen sich Mirantis k0rdent Enterprise und MKE 4k besonders auch für Unternehmen, die ihre Anwendungsportfolios modernisieren und ihre Edge-Infrastruktur mit KI- und Cloud-nativen Workloads erweitern möchten.

Mirantis zeigt Mirantis k0rdent Enterprise und die Virtualisierungs- und KI-Integrationsfunktionen auf der KubeCon North America 2025 in Atlanta (11. bis 13. November, Stand 820).

Weitere Informationen finden sich auch unter https://www.mirantis.com/….

Mirantis bietet den schnellsten Weg zu skalierbarer KI für Unternehmen mit Full-Stack-KI-Infrastruktur-Technologien, die die Komplexität der GPU-Infrastruktur beseitigen und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Heute ist jede Infrastruktur auch KI-Infrastruktur. Mirantis stellt End-to-End-Automatisierung, Sicherheit und Governance auf Enterprise-Niveau sowie umfassende Expertise im Bereich Kubernetes-Orchestrierung zur Verfügung – Aspekte, die für Unternehmen essentiell sind, um die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – lokal, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

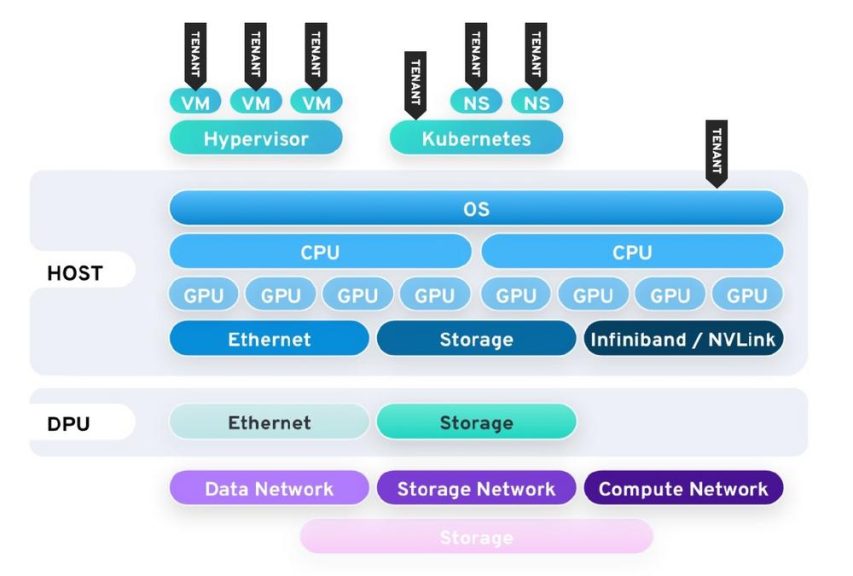

Aufbau einer KI-Infrastruktur der nächsten Generation: Mirantis kündigt Integration mit Nvidia BlueField an

Als Spezialist für Kubernetes-native KI-Infrastruktur ist Mirantis ist einer der ersten Design- und Integrationspartner, der mit Nvidia BlueField sichere Multi-Tenant-Netzwerke für KI bereitstellt. Durch die Kombination der deklarativen, Kubernetes-nativen Funktionen von Mirantis k0rdent AI mit den leistungsstarken Datenverarbeitungs- und Isolationsfunktionen von Nvidia BlueField können Unternehmen eine Infrastruktur aufbauen, die nicht nur für KI optimiert, sondern auch kontrolliert, flexibel und kosteneffektiv ist.

„KI-Workloads erfordern Präzision. Dies setzt spezialisierte Hardware, eng integrierte Netzwerke, sichere Multi-Tenant-Architekturen und Bereitstellung in Echtzeit voraus. Alles muss zudem effizient und skalierbar orchestriert werden“, sagt Shaun O’Meara, Chief Technology Officer bei Mirantis. „Mit der Integration von Mirantis k0rdent AI und Nvidia BlueField bieten wir Multi-Tenant-Kubernetes mit strikter Isolierung auf allen Ebenen. Dies bedeutet Unterstützung für komplexe Netzwerke und Abgrenzung, während Tenants dennoch voller Zugriff auf ihren Kubernetes-Cluster ermöglicht wird."

Die Bereitstellung einer Infrastruktur für KI-High-Performance-Computing bringt sehr spezielle Herausforderungen mit sich und erfordert besondere Feinabstimmung und Konfiguration. Dies umfasst beispielsweise die Zuweisung und Aufteilung von GPUs, die Aktivierung von RDMA-Netzwerken (Remote Direct Memory Access), die Erfüllung anspruchsvoller Planungsanforderungen, die Leistungsoptimierung und die effiziente Skalierung von Plattformen wie Kubernetes. Die Komplexität steigt, wenn Lösungen mehrere dynamische Workloads unterstützen müssen, welche von verschiedenen Benutzern gemeinsam genutzt werden.

Mirantis k0rdent AI und Nvidia BlueField bieten:

– Multi-Tenant-Unterstützung für Datensicherheit und gemeinsame Ressourcennutzung

– Datensouveränität für KI-Workloads, die auf vertraulichen Daten basieren und häufig proprietäre Modelle enthalten

– Möglichkeit zur gemeinsamen Nutzung von GPUs und anderen wichtigen Rechenressourcen

– Strenge Netzwerkisolierung auf Netzwerk-Schnittstellenebene, wobei Tenants ausschließlich Zugriff auf die ihnen zugewiesenen Schnittstellen haben – und diese Schnittstellen wiederum nur Zugriff auf die dem jeweiligen Mandanten zugewiesenen VLANs

– Hochgeschwindigkeitszugriff auf Datenspeicher

Mirantis bereitet sich außerdem auf die Unterstützung des neu angekündigten Nvidia BlueField-4 vor, welches im Vergleich zu BlueField-3 eine sechsmal höhere Rechenleistung und einen doppelt so hohen Netzwerkdurchsatz bietet. Mirantis geht davon aus, dass dadurch die zugrunde liegenden Switch-Konfigurationen vereinfacht und eine Echtzeit-Risikoerkennung ermöglicht werden.

Die Integration von Mirantis k0rdent AI und Nvidia BlueField bietet flexible, wiederholbare Muster für die Bereitstellung von Diensten für Endbenutzer über Templates. Dadurch kann eine konsistente Infrastruktur bereitgestellt werden und Konfigurationsabweichungen lassen sich verhindern. Diese Herangehensweise ermöglicht die Automatisierung der Infrastrukturbereitstellung als Service.

Weitere Informationen finden sich auch im Blogbeitrag Mirantis and NVIDIA BlueField Next-Generation.

Mirantis bietet den schnellsten Weg zu skalierbarer KI für Unternehmen mit Full-Stack-KI-Infrastruktur-Technologien, die die Komplexität der GPU-Infrastruktur beseitigen und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“. Heute ist jede Infrastruktur auch KI-Infrastruktur. Mirantis stellt End-to-End-Automatisierung, Sicherheit und Governance auf Enterprise-Niveau sowie umfassende Expertise im Bereich Kubernetes-Orchestrierung zur Verfügung – Aspekte, die für Unternehmen essentiell sind, um die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – lokal, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale. Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

Mirantis optimiert das Management von Ceph Storage auf Kubernetes

Pelagia ergänzt Rook, ein von der Cloud Native Computing Foundation (CNCF) gehostetes Open-Source-Projekt, um Lifecycle-Automatisierung. Dies optimiert insbesondere den Betrieb großer Bereitstellungen mit hohem Traffic.

„In Pelagia findet sich all die Erfahrung wieder, die wir in jahrelanger Arbeit mit Ceph in Produktionsumgebungen gesammelt haben“, erklärt Shaun O’Meara, CTO bei Mirantis. „Pelagia arbeitet mit Rook zusammen und bietet die erforderliche Lifecycle-Automatisierung und eine vereinfachte Kontrollebene für große Umgebungen, ganz unabhängig davon, ob diese auf Bare Metal oder virtuellen Maschinen basieren.“

Pelagia stammt aus der Lösung Mirantis OpenStack for Kubernetes (MOSK). Diese kommt seit über fünf Jahren bei der Bereitstellung und Verwaltung großer Ceph-Cluster zum Einsatz, bei denen Zuverlässigkeit von entscheidender Bedeutung ist. Mirantis veröffentlicht Pelagia als Open-Source-Software und macht es damit für alle zugänglich.Pelagia vereinfacht den Betrieb, verbessert die Transparenz des Clusterstatus für den Betreiber und lässt sich in GitOps-Workflows einfügen. Die Lösung standardisiert dadurch die Art und Weise, wie Ceph in Kubernetes-Clustern betrieben wird.Pelagia dient zudem als Storage-Lifecycle-Schicht für die umfassendere Infrastrukturstrategie von Mirantis, einschließlich des Open-Source-Controllers Rockoon für OpenStack und der modularen Plattform k0rdent für Kubernetes-native Clouds.

„Die meisten OpenStack-Deployments setzen auf die Integration von OpenStack, Kubernetes und Ceph. Bei Millionen Kernen weltweit kommt dieser offene Infrastruktur-Entwurf zum Einsatz“, sagt Thierry Carrez, General Manager der OpenInfra Foundation. „Dass Mirantis Pelagia nun für die Community öffnet, steht im Einklang mit dem langjährigen Engagement des Unternehmens für diese Open-Source-Infrastrukturprojekte. Best Practices und Erfahrung von Mirantis fließen damit in eine Software, die von allen OpenStack- und Kubernetes-Anwendern genutzt werden kann.“

Als langjähriger Unterstützer von Open Source ist Mirantis aktiv an mehr als 50 Open-Source-Projekten beteiligt und leistet Beiträge zu diesen. Gesteuert werden diese Aktivitäten vom Open Source Program Office des Unternehmens unter der Leitung von Randy Bias.

Pelagia spielt eine zentrale Rolle bei der Virtualisierungsunterstützung von k0rdent und ermöglicht ein konsistentes, planbares Lifecycle-Management von Ceph-gestützten, persistenten Volumes für KubeVirt-basierte VMs. Mirantis plant, Pelagia mit entsprechenden Standardeinstellungen und getesteten Integrationen in den k0rdent-Anwendungskatalog aufzunehmen.

Pelagia ist ab sofort unter einer Open-Source-Lizenz verfügbar. Eine Anleitung steht unter https://mirantis.github.io/… bereit. Weitere Informationen finden sich auch in der entsprechenden User-Diskussionsgruppe auf GitHub.

Über Mirantis Mirantis bietet den schnellsten Weg zu skalierbarer KI für Unternehmen mit Full-Stack-KI-Infrastruktur-Technologien, die die Komplexität der GPU-Infrastruktur beseitigen und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“.Heute ist jede Infrastruktur auch KI-Infrastruktur. Mirantis stellt End-to-End-Automatisierung, Sicherheit und Governance auf Enterprise-Niveau sowie umfassende Expertise im Bereich Kubernetes-Orchestrierung zur Verfügung – Aspekte, die für Unternehmen essentiell sind, um die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – lokal, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

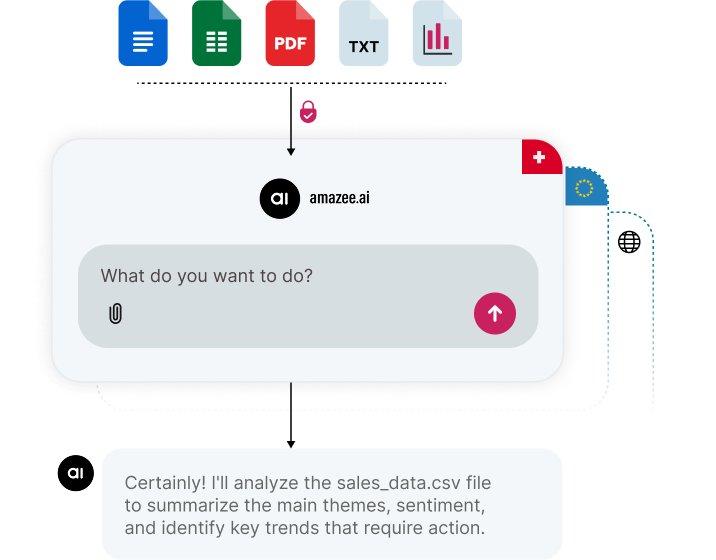

Private AI Assistant von amazee.ai bietet Unternehmen beim KI-Einsatz die vollständige Kontrolle über ihre Daten

Zu den wichtigsten Funktionen und Vorteilen von amazee.ai Private AI Assistant zählen:

● Regionsspezifische Datenverarbeitung zur Unterstützung von Datensouveränität und Compliance

● Keine Speicherung von Prompts oder Ergebnissen, wodurch das Risiko einer unbeabsichtigten Datenpreisgabe ausgeschlossen wird

● No-Code-Einrichtung – auch ohne Entwickler können grundlegende KI-Workflows konfiguriert werden

● Datenschutz und Compliance auf Enterprise-Niveau zu attraktiven Konditionen

Anwender können interne Daten wie Dokumente, CRM-Datensätze oder Support-Tickets hochladen, um KI-Erkenntnisse, Zusammenfassungen, Berichte oder automatisierte Antworten zu generieren. Zukünftige Versionen des Private AI Assistant werden es Benutzern darüber hinaus ermöglichen, sich direkt mit ihrem CRM, ERP und anderen Systemen zu verbinden, um Arbeitsabläufe weiter zu optimieren und die Effizienz zu steigern.

„Viele Menschen nutzen kostenlose Versionen von Tools wie ChatGPT, Claude oder Gemini, um ihre Arbeit schneller zu erledigen. Und dies, ohne sich der Auswirkungen bewusst zu sein, die die Weitergabe sensibler Daten mit sich bringen kann, die dann außerhalb des Unternehmens gespeichert und zum Trainieren von Modellen verwendet werden“, sagt Michael Schmid, Mitgründer und Managing Director von amazee.ai. „Mit Private AI Assistant werden keine Prompts oder Ergebnisse gespeichert und keine Daten verlassen die vom Benutzer gewählte Region. Es gelangen keine Daten aus dem Unternehmen nach außen, was für vollständigen Schutz vor einer Offenlegung sorgt.“

Im Deloitte-Report „State of Ethics and Trust in Technology“ wird Datenschutz als wichtigstes Thema im Zusammenhang mit generativer KI hervorgehoben. 72 % der Befragten nannten den Datenschutz als eines ihrer drei wichtigsten Anliegen. Der Private AI Assistant geht genau diese Herausforderung direkt an, indem sichere, compliancegerechte KI für unterschiedlichste Unternehmen und Organisationen zugänglich wird und eine Alternative zu KI-Modellen wie ChatGPT, Claude und Gemini zur Verfügung steht. Mit dem Private AI Assistant von amazee.ai können Unternehmen die Vorteile der KI nutzen, ohne dabei sensible Daten preiszugeben. Sie können dabei genau auswählen, wo ihre Daten verarbeitet und aufbewahrt werden. Da amazee.ai weder Prompts noch Ergebnisse speichert, besteht kein Risiko, dass sensible Informationen die Kontrolle des Unternehmens verlassen.

Mirantis und amazee.ai unterstützen Unternehmen beim Aufbau einer skalierbaren, sicheren KI. Mit dem Private AI Assistant können Organisationen kontrollieren, wohin ihre Daten gelangen. Dies macht die Lösung ideal für den Einsatz in kritischen Bereichen wie beispielsweise im Gesundheitswesen, im Finanzsegment und im öffentlichen Sektor, wo Bedenken hinsichtlich des Datenschutzes von Patienten, mit Blick auf regulatorische Vorschriften oder die nationale Sicherheit bestehen. Der Private AI Assistant kann dazu beitragen, die Einhaltung von Vorschriften wie DSGVO oder HIPAA (US-amerikanisches Gesetz zum Schutz von Gesundheitsdaten) sicherzustellen.

Weitere Informationen finden sich auch in diesem Blogbeitrag: Private AI: Why smart companies stay in control of their data

Preise und Verfügbarkeit:

Die Beta-Version des Private AI Assistant steht ab sofort allen Interessierten zur Verfügung, die die Lösung testen und evaluieren möchten.

Die Registrierung ist unter https://amazee.ai/… möglich.Die Preise starten bei 125 US-Dollar pro Monat für 20 Benutzer, wobei mit steigender Benutzerzahl zusätzliche Rabatte gewährt werden.

Über amazee.ai

amazee.ai, ein Schwesterunternehmen von amazee.io, das 2022 von Mirantis übernommen wurde, bietet datenschutzorientierte KI-Lösungen und -Infrastrukturen, die Datensouveränität gewährleisten und es Unternehmen ermöglichen, KI sicher und unter Einhaltung der regulatorischen Vorschriften einzusetzen. Auf Basis einer Privacy-First-Philosophie stellt amazee.ai KI-Lösungen für verschiedene Technologien zur Verfügung, die sich auf die gleiche Zuverlässigkeit und den gleichen Support stützen, für die das Schwesterunternehmen amazee.io im Bereich Managed Web Hosting bekannt ist.

Mirantis bietet den schnellsten Weg zu skalierbarer KI für Unternehmen mit Full-Stack-KI-Infrastruktur-Technologien, die die Komplexität der GPU-Infrastruktur beseitigen und den Betrieb über den gesamten KI-Lebenszyklus optimieren – „Metal-to-Model“.Heute ist jede Infrastruktur auch KI-Infrastruktur. Mirantis stellt End-to-End-Automatisierung, Sicherheit und Governance auf Enterprise-Niveau sowie umfassende Expertise im Bereich Kubernetes-Orchestrierung zur Verfügung – Aspekte, die für Unternehmen essentiell sind, um die Time-to-Market zu verkürzen und Cloud-native, virtualisierte und GPU-gestützte Anwendungen in jeder Umgebung effizient zu skalieren – lokal, in der Public Cloud, hybrid oder auf Edge-Geräten.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, MetLife, PayPal und Société Générale. Weitere Informationen: www.mirantis.com

Mirantis ist eine eingetragene Marke von Mirantis, Inc. Metal-to-Model ist eine Marke von Mirantis, Inc. Alle anderen Marken sind Eigentum ihrer jeweiligen Inhaber.

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()

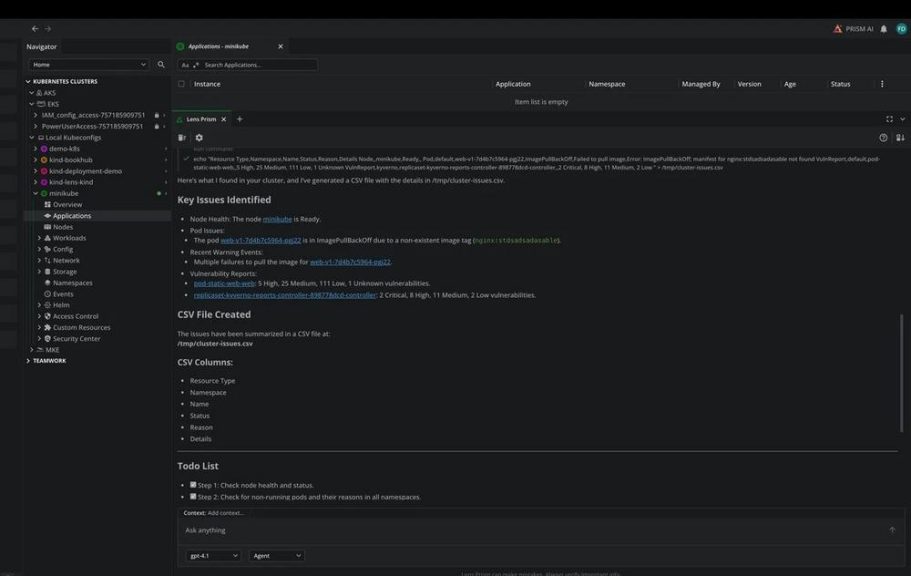

Mirantis stellt mit Lens Prism den ersten integrierten KI-Assistenten für Kubernetes vor

Durch eine neue One-Click-Integration von Amazon Web Services (AWS) haben Anwender vollen Überblick über EKS-Cluster und können über Accounts und Regionen hinweg eine Verbindung herstellen, ohne dass Befehlszeilen aufgesetzt oder Anmeldedaten verwaltet werden müssen. Dies optimiert den Zugriff auf die Cloud-Infrastruktur, vereinfacht die operativen Workflows und macht Lens zu einer zentralen Plattform für das Management verteilter Kubernetes-Umgebungen mit mehr Geschwindigkeit und Kontrolle.

„Wir beschäftigen uns mit dem Hauptproblem von Kubernetes, der Komplexität“, sagt Miska Kaipiainen, Head of Product für Lens bei Mirantis. „Lens Prism bringt die Leistungsfähigkeit eines Site Reliability Engineers (SRE) in die IDE jedes Entwicklers. Es beseitigt Reibungsverluste im täglichen Kubernetes-Betrieb. Gleichzeitig ist für Sicherheit und Kontrolle auf Enterprise-Niveau gesorgt.“

Im Gegensatz zu browserbasierten Chatbots oder generischen KI-Lösungen ist Lens Prism tief in Lens Desktop integriert und auf den jeweiligen Kontext des Benutzers zugeschnitten – etwa im Hinblick auf Aspekte wie aktueller Cluster, Namespace, Workloads und RBAC-Berechtigungen (rollenbasierte Zugriffskontrolle). Benutzer können Fragen stellen wie etwa:

„Was läuft mit meinem Pod falsch?“

„Wie viel CPU-Leistung nutzt dieser Namespace?“

„Gibt es Fehler in meinem Cluster?“

Prism antwortet mit Live-Einblicken, die auf kubectl-Output in Echtzeit, Metriken und Log-Daten basieren. Es werden Befehle generiert, die sich sofort ausführen lassen und mit denen Benutzer Probleme sicher verstehen, überprüfen und letztlich beheben können.

Lens Prism arbeitet mit rollenbasierten Zugriffsberechtigungen (RBAC) und läuft vollständig innerhalb der bestehenden kubeconfig des Benutzers. Zusammen ermöglichen es Lens Prism und die One-Click-AWS-Integration Teams, Probleme schneller zu lösen, sicher in verschiedenen Umgebungen zu arbeiten und das Kubernetes-Management ohne zusätzliche Komplexität oder Overhead zu skalieren.

Mehr als eine Million Kubernetes-Nutzer vertrauen auf Lens, um produktiver zu arbeiten. Lens ist als Desktop-Anwendung konzipiert. Die Lösung senkt die Einstiegshürde für diejenigen, die gerade erst mit Kubernetes starten. Gleichzeitig sorgt sie für mehr Produktivität bei Anwendern, die bereits über Erfahrung mit Kubernetes verfügen. Als ebenso beliebte wie fortschrittliche Kubernetes-IDE ermöglicht es Lens Anwendern, Kubernetes und Workloads über mehrere Cluster hinweg in Echtzeit zu verwalten, zu entwickeln, zu debuggen, zu überwachen und Fehler zu beheben. Unterstützt wird dabei jede zertifizierte Kubernetes-Distribution in jeder Infrastruktur. Lens bietet eine intuitiv nutzbare grafische Benutzeroberfläche und läuft unter Linux, macOS und Windows.

Lens Prism und die One-Click-AWS-Integration stehen ab sofort ohne zusätzliche Kosten in allen Lens Premium-Tarifen (Plus, Pro und Enterprise) zur Verfügung. Weitere Informationen über Lens und die Möglichkeit zum Download finden sich unter https://k8slens.dev.

Über Lens

Lens von Mirantis ist die weltweit am häufigsten verwendete Kubernetes-IDE. Über eine Million Entwickler und Betreiber setzen auf Lens, um die Clusterverwaltung zu vereinfachen, DevOps-Workflows zu optimieren und die Cloud-native Entwicklung zu beschleunigen.

Über Mirantis

Durch Open-Source-Lösungen für die Bereitstellung und das Management von modernen, verteilten Applikationen unterstützt Mirantis Unternehmen dabei, den Betrieb zu vereinfachen, Komplexität zu reduzieren und Innovation zu beschleunigen. Mirantis ermöglicht es Platform-Engineering-Teams, sichere, skalierbare und individuell anpassbare Entwicklerplattformen in unterschiedlichen Infrastrukturen aufzubauen und zu betreiben – On-Premises, in Public-Cloud-Umgebungen, hybrid oder auf Edge-Geräten.

KI-gesteuerte Workloads entwickeln sich zu einem Kern moderner Architekturen. Mirantis bietet die Automatisierung, Multi-Cloud-Orchestrierung und Infrastruktur-Flexibilität, die für die Unterstützung von leistungsstarker KI, maschinellem Lernen und datenintensiven Anwendungen erforderlich sind. Mirantis setzt sich für offene Standards ein und vermeidet Vendor-Lock-in-Szenarien. Unternehmen und Organisationen werden auf diese Weise in die Lage versetzt, Infrastrukturen und Dienste zu ihren eigenen Bedingungen bereitzustellen und zu betreiben.

Mirantis arbeitet mit vielen weltweit führenden Unternehmen zusammen, darunter Adobe, Ericsson, Inmarsat, PayPal und Société Générale.

Weitere Informationen: www.mirantis.com

Mirantis

900 E Hamilton Avenue

USA95008 Campbell, CA

Telefon: +1 (650) 963-9828

Telefax: +1 (650) 968-2997

http://www.mirantis.com

Press

Telefon: 0033 06 63 44 33 74

E-Mail: mmonclin@mirantis.com

Pressekontakt DACH

Telefon: 0049 89 6230 3490

E-Mail: hansel@fx-kommunikation.de

![]()